Indeks Jaccarda – to chyba kolejne pojęcie, które nie mówi zbyt dużo większości czytelników. Mnie zauroczył najbardziej jego początek – alpejskie łąki, kwiaty. Potrafię sobie wybrazić taki obrazek i tego „naukowca”, który zamiast zachwycać się pięknem przyrody, postanawia przeanalizować podobieństwo pomiędzy wspomnianymi łąkami. Jaki odsetek gatunków z jednej lokalizacji powtarza się na innej? Od tego się zaczęło, a potem było wykorzystywane do analizy zmian przebiegu koryta rzeki czy do porównań różnych tekstów. Aktualnie Indeks Jaccarda ma swoje zastosowanie w NLP więc warto jak najlepiej go poznać, żeby móc wykorzystać, kiedy pracujemy z danymi tekstowymi.

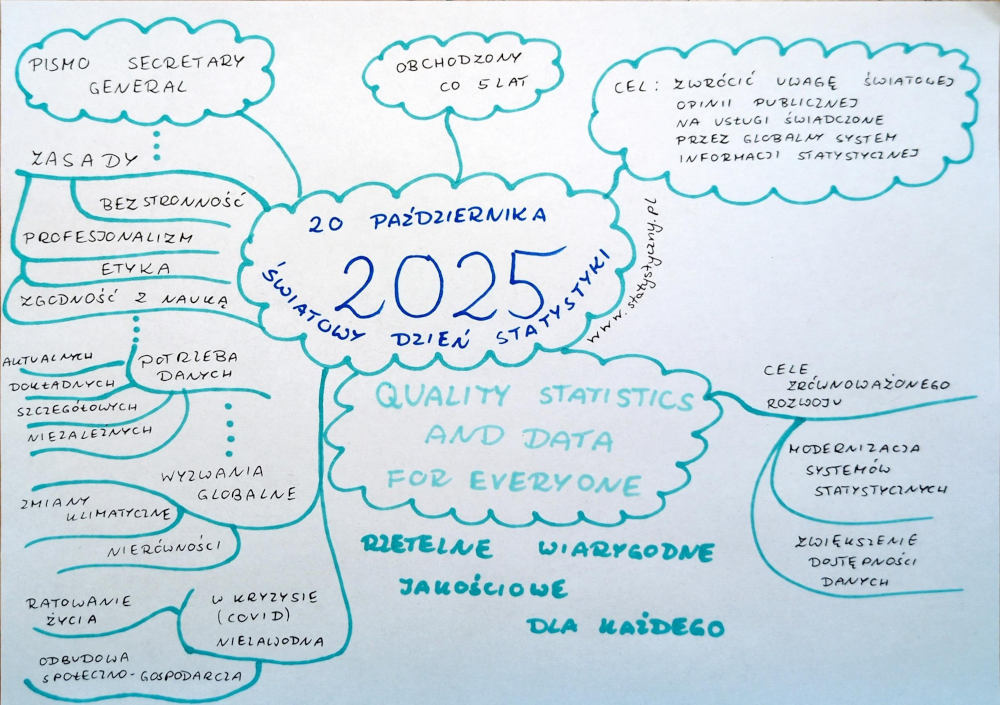

Światowy Dzień Statystyki 2025

Próbowałam znaleźć dlaczego jest obchodzony tylko raz na 5 lat. Jedyne co się dowiedziałam, to że rzadka częstotliwość nadaje wydarzeniu prestiżowy, międzynarodowy charakter. W każdym razie to właśnie teraz możemy świętować Światowy Dzień Statystyki 2025. Jak co te pięć lat, 20 października, będziemy mogli rozkoszować się faktem, że tylu statystyków na całym świecie stara się prężnie działać, abyśmy mogli korzystać z jakościowych danych. Tegoroczne hasło bowiem to „Quality statistics and data for everyone” – czyli, że te rzetelne, wiarygodne, jakościowe dane i statystyki mają być dostępne dla każdego, kto jest nimi zainteresowany.

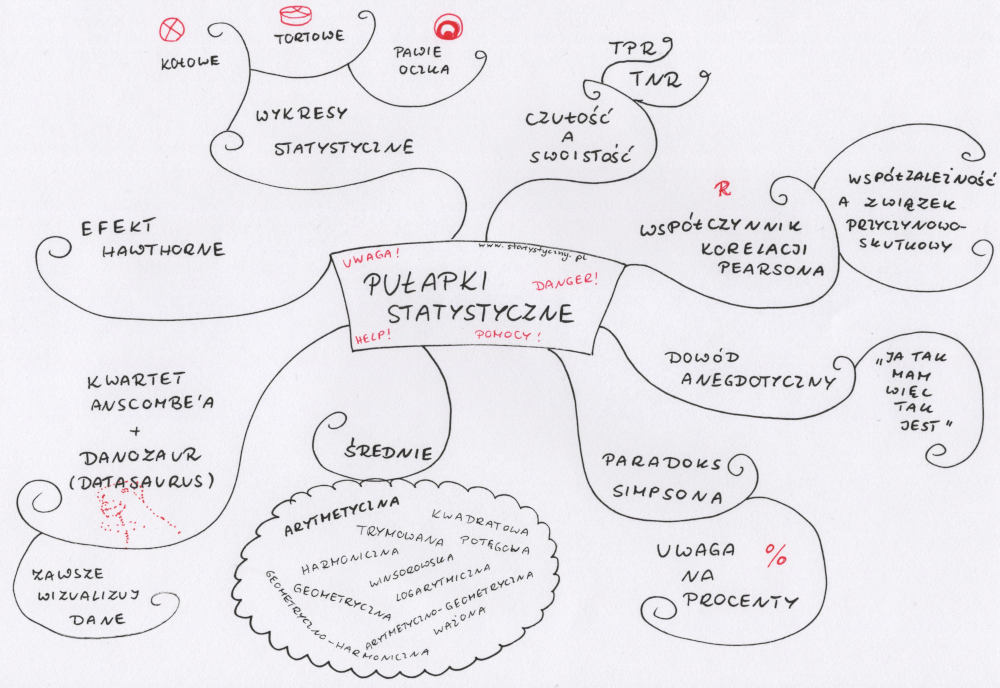

Czytaj dalejPułapki statystyczne – co czyha, żeby nas zmylić?

Statystyka nie jest bardzo trudna. Ale jak każda dziedzina wiedzy wymaga, żeby się z nią zaprzyjaźnić i dobrze zrozumieć. I jak każda dziedzina wiedzy ma swoje pułapki, które bardziej doświadczone osoby widzą na pierwszy rzut oka, a początkujący łatwo mogą w nie wpaść. Dzisiaj przedstawiam kilka podpowiedzi, na co warto zwrócić uwagę podczas swojej przygody ze statystyką. Co trzeba zrobić, żeby nie wpaść w pułapki statystyczne?

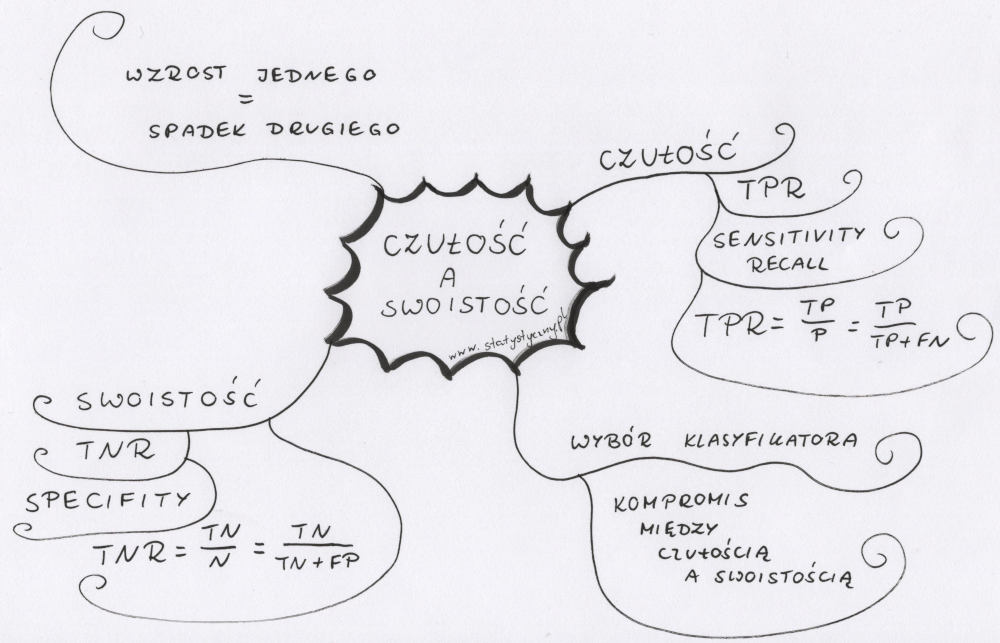

Czytaj dalejCzułość a swoistość – dlaczego musimy się tym martwić?

Po przerwie wracam do tematu macierzy błędów oraz do czułości (TPR, ang. sensitivity) i swoistości (TNR, ang. specifity). Dlaczego czułość i swoistość są tak ważne? Dlaczego wciąż o tym piszę począwszy od tematu macierzy błędów, przez ROC, AUC i współczynnik Youdena? Dlaczego powtarzam, że zwiększając jedno, wpływamy na drugie i że szukanie punktu odcięcia – kiedy uznamy kogoś za chorego (albo badany obiekt za jabłko) to bardzo poważna decyzja? Już Wam mówię, dlaczego.

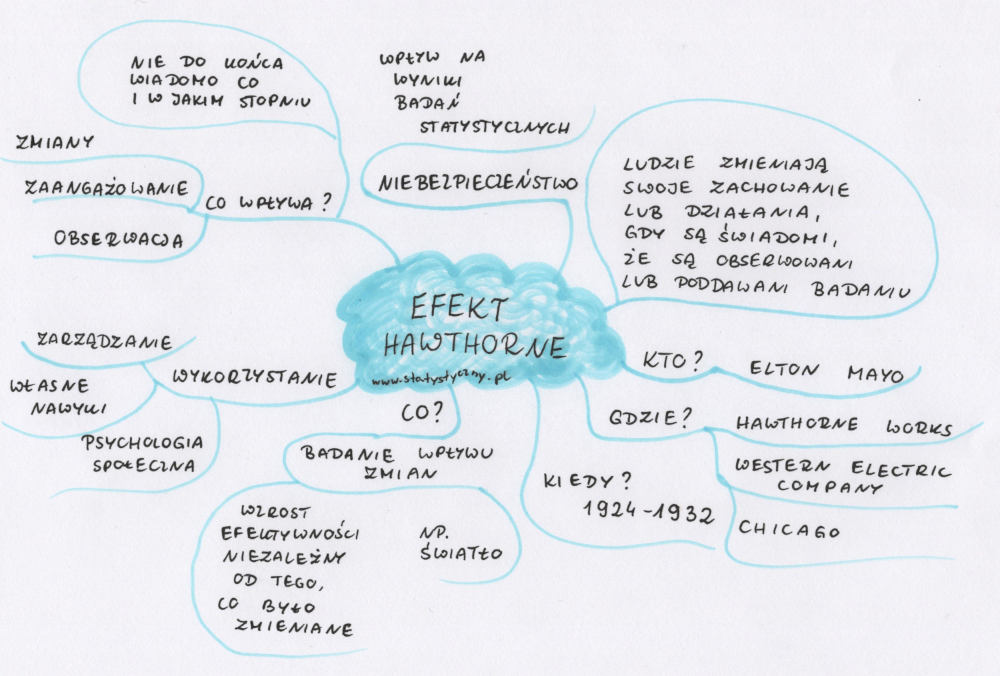

Czytaj dalejEfekt Hawthorne – badanie zachowań ludzkich bywa naprawdę trudne

Efekt Hawthorne – czytałam o tym albo słyszałam już kilka razy i zawsze myślałam, że to jest coś, co warto opisać czytelnikom statystycznego. A potem zapominałam. I tak już wielokrotnie. Ale ostatnio znowu w jednej z czytanych książek natrafiłam na te słowa i stwierdziłam, że to już najwyższy czas, żeby zabrać się za ten temat. Tak więc zaraz dowiecie się, kto i kiedy opisał efekt Hawthorne. Jakie problemy sprawia w statystyce. I opowiem Wam jeszcze, jak można wykorzystać ten efekt w codziennym życiu. Chociażby po to, żeby… schudnąć… Jesteście ciekawi? Mam nadzieję, że tak.

Czytaj dalej